Google è un’azienda che già da molto tempo porta avanti esperimenti e studi basati sul binomio Intelligenza Artificiale – immagine. I ricercatori hanno sempre utilizzato dei CNN (convolutional neural networks) in grado di dare una valutazione ristretta alla qualità dell’immagine ma ora viene introdotto un nuovo CNN chiamato NIMA (Neural Image Assessment) capace di dare una valutazione anche tecnica e qualitativa alla stessa.

Il precendente CNN utilizzato da Google poteva valutare solo tecnicamente un’immagine attraverso una misurazione a livello di pixel su dati come rumore, sfocatura o artefatti di compressione, classificandola in due classi di qualità: alta o bassa. Il modello NIMA aggiunge un fattore più "soggettivo" a questa valutazione, è un deep CNN addestrato a riconoscere quali immagini un utente riterrebbe interessanti sia tecnicamente che (e questa è la novità) esteticamente; dopo un allenamento basato su un database di immagini classificate e giudicate singolarmente da una media di 200 persone, si è scoperto che NIMA è in grado di valutare altri set di immagini e dare punteggi qualitativi molto simili alle predizioni umane. Non solo. I dati forniti dal punteggio NIMA possono essere utilizzati per costruire ulteriori algoritmi specifici per l’editing delle foto, come ad esempio un nuovo CNN in grado di trovare le impostazioni esteticamente ottimali dei parametri di scatto come luminosità, luci e ombre.

Il progetto è ancora embrionale ma sicuramente è un ulteriore passo verso il futuro. NIMA si basa sulla capacità di comprendere categorie generali di oggetti e può essere utilizzata non solo per valutare le immagini ma anche per una varietà di compiti laboriosi e soggettivi come il fotoritocco.

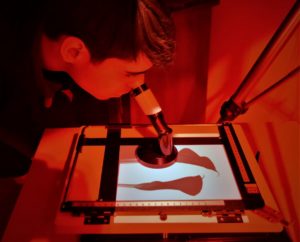

Punteggi NIMA sulla distorsione

Editing basato su dati NIMA